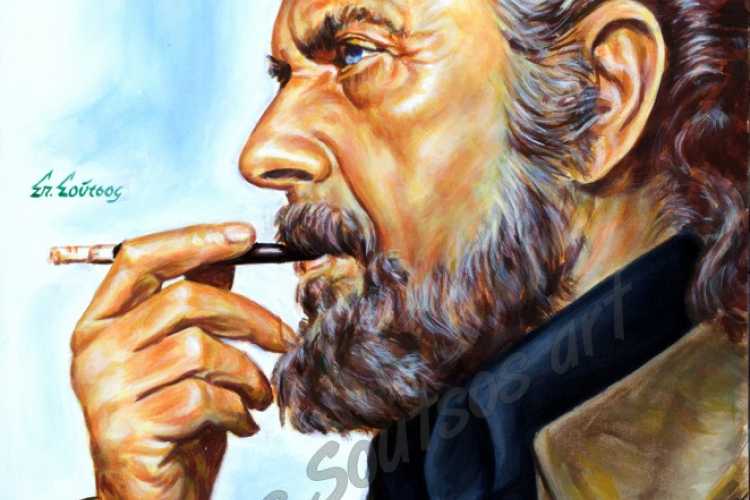

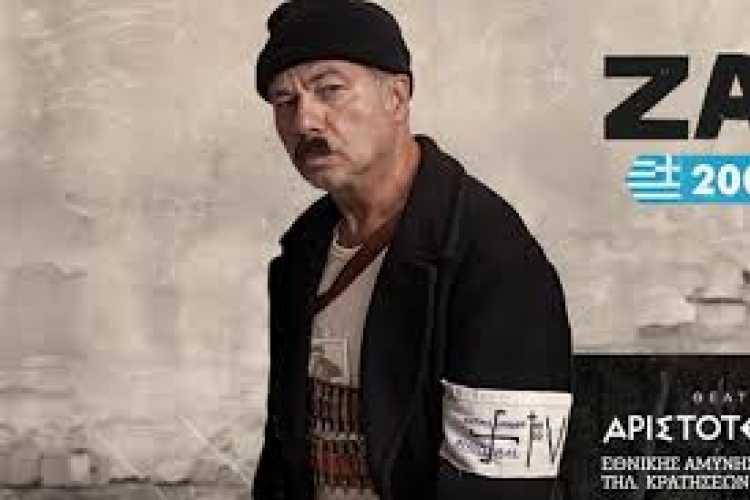

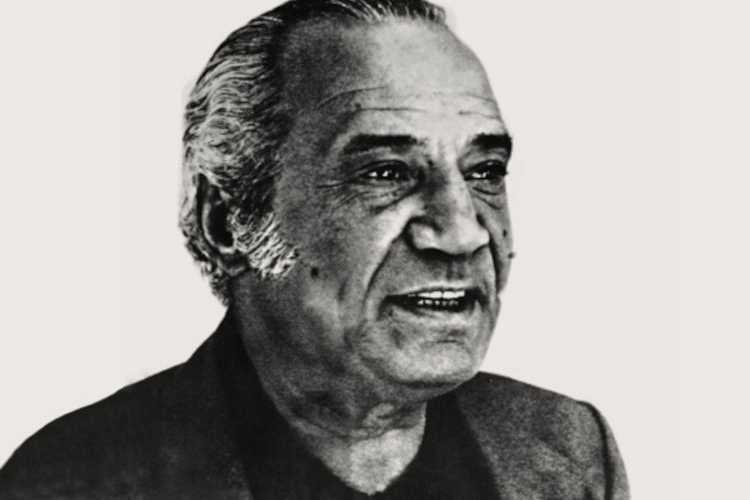

Το εργαλείο ChatGPT Images 2.0 είναι ικανό να δημιουργεί ιδιαίτερα πειστικές εικόνες, όπως στιγμιότυπα που απεικονίζουν δημόσια πρόσωπα σε φανταστικά σενάρια, τα οποία σε πρώτη όψη μοιάζουν αληθινά

Ένα νέο μοντέλο δημιουργίας εικόνων τεχνητής νοημοσύνης της OpenAI, το ChatGPT Images 2.0, παρουσιάζει αυξημένες δυνατότητες παραγωγής φωτορεαλιστικών εικόνων, εγείροντας ανησυχίες σχετικά με την πιθανή χρήση του για παραπληροφόρηση και απάτες, σύμφωνα με δημοσίευμα του The Atlantic.

Το εργαλείο είναι ικανό να δημιουργεί ιδιαίτερα πειστικές εικόνες, όπως στιγμιότυπα που απεικονίζουν δημόσια πρόσωπα σε φανταστικά σενάρια, τα οποία σε πρώτη όψη μοιάζουν αληθινά. Σε δοκιμές χρήσης του μοντέλου, παρατηρήθηκε ότι οι παραγόμενες εικόνες δεν περιείχαν τα συνηθισμένα εμφανή σφάλματα προηγούμενων συστημάτων, όπως παραμορφώσεις σε ανθρώπινα άκρα ή αφύσικη γεωμετρία.

Σύμφωνα με περιγραφές χρήσης του εργαλείου, το σύστημα μπορεί να δημιουργήσει μεγάλο αριθμό ψεύτικων εικόνων, συμπεριλαμβανομένων εγγράφων, αναρτήσεων κοινωνικών δικτύων, τραπεζικών ειδοποιήσεων, ταυτοτήτων και ταξιδιωτικών εγγράφων. Ιδιαίτερη έμφαση δίνεται στη δυνατότητα παραγωγής εικόνων με ευανάγνωστο κείμενο, κάτι που αποτελούσε μέχρι πρότινος σημαντική τεχνική αδυναμία των μοντέλων εικόνας.

Η ικανότητα αυτή καθιστά το εργαλείο πιο προηγμένο σε επίπεδο γραφιστικής, αλλά ταυτόχρονα ενδέχεται να διευκολύνει τη δημιουργία παραποιημένων εγγράφων. Σε δοκιμές, το σύστημα παρήγαγε εικόνες που προσομοιάζουν ιατρικές συνταγές, κάρτες εμβολιασμού, ιατρικές εξετάσεις, τιμολόγια, αποδείξεις και φορολογικά έγγραφα.

Αν και οι εικόνες αυτές ήταν συχνά πειστικές, σε αρκετές περιπτώσεις εντοπίστηκαν μικρά σφάλματα, όπως λανθασμένοι υπολογισμοί φόρων ή μη ρεαλιστική απεικόνιση χειρόγραφου κειμένου. Παράλληλα, η παραγωγή ψεύτικων ταξιδιωτικών εγγράφων και καρτών επιβίβασης έδειξε ότι, αν και οπτικά ρεαλιστικές, οι εικόνες δεν περιλαμβάνουν λειτουργικά στοιχεία όπως έγκυρους γραμμωτούς κώδικες.

Ιδιαίτερη ανησυχία προκαλεί η δυνατότητα δημιουργίας ψεύτικων στιγμιότυπων οθόνης τραπεζικών συναλλαγών και ειδοποιήσεων, τα οποία θα μπορούσαν να χρησιμοποιηθούν σε προσπάθειες ηλεκτρονικής απάτης (phishing), όπου χρήστες ενδέχεται να παραπλανηθούν ώστε να αποκαλύψουν προσωπικά δεδομένα.

Ειδικοί στον τομέα της ασφάλειας επισημαίνουν ότι η εξέλιξη της τεχνολογίας εικόνας έχει ιστορικά συνδεθεί με νέες μορφές απάτης. Από την εξάπλωση των φωτοαντιγραφικών και των εκτυπωτών έως τη χρήση λογισμικών επεξεργασίας εικόνας, οι μέθοδοι παραποίησης εξελίσσονται διαρκώς. Ωστόσο, η ταχύτητα και η ευκολία παραγωγής ρεαλιστικών εικόνων μέσω τεχνητής νοημοσύνης θεωρείται ποιοτικά νέα πρόκληση.

Σύμφωνα με αναφορές, το FBI έχει καταγράψει σημαντικές οικονομικές απώλειες από απάτες που σχετίζονται με τεχνητή νοημοσύνη, ενώ παρατηρείται αύξηση περιστατικών όπου παραποιημένες αποδείξεις χρησιμοποιούνται για οικονομική εξαπάτηση.

Εταιρείες τεχνολογίας, όπως η OpenAI και η Google, αναφέρουν ότι εφαρμόζουν μηχανισμούς ασφαλείας και ανίχνευσης, όπως υδατογραφήματα και εργαλεία επαλήθευσης εικόνων. Ωστόσο, ειδικοί σημειώνουν ότι τέτοια μέτρα δεν είναι πάντα επαρκή, καθώς οι εικόνες μπορούν να τροποποιηθούν ή να αφαιρεθούν τα μεταδεδομένα τους.

Την ίδια στιγμή, η ύπαρξη ανοιχτών μοντέλων τεχνητής νοημοσύνης δυσχεραίνει τον έλεγχο της διάδοσης τέτοιων εργαλείων, δημιουργώντας προκλήσεις για τράπεζες, νοσοκομεία και δημόσιες υπηρεσίες στην πρόληψη ψηφιακής απάτης.

Αναλυτές τονίζουν ότι, πέρα από τα ακραία σενάρια πολιτικής παραπληροφόρησης, μεγαλύτερο κίνδυνο ενδέχεται να αποτελούν οι στοχευμένες και καθημερινές μορφές απάτης, οι οποίες μπορούν να επηρεάσουν απλούς πολίτες σε προσωπικό επίπεδο.